교차 엔트로피 (분포 간)

정보이론 · easy

교차 엔트로피 (Cross Entropy)

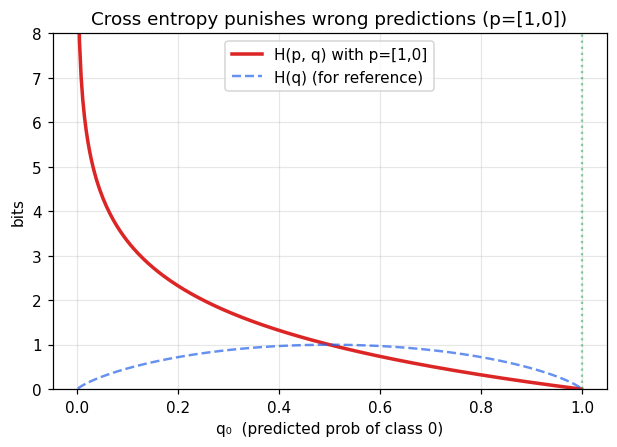

엔트로피(36번) 가 한 분포 의 불확실성을 재는 양이라면, 교차 엔트로피는 진짜 분포 p 를 예측 분포 q 로 설명 할 때 필요한 평균 비트 수:

성질

- 항상 (깁스 부등식).

- 이면 .

q가p와 다를수록 값이 커짐 → "얼마나 잘못 예측했는가" 측정.

머신러닝에서

- 레이블

y를 one-hot으로 표현한 게p, 모델 softmax 출력이q. - 교차 엔트로피 손실 = 분류 모델을 맞추는 기본 loss.

- 0 확률 로그 문제 → 클리핑 으로 방어 (

q → max(q, 1e-12)).

과제

함수 cross_entropy(p, q) 를 완성하세요.

- 입력: 같은 길이의 확률 배열 두 개.

- 반환: Python

float, bits. q <= 0에서 NaN 없도록 클리핑.

테스트 케이스

| # | 이름 | p | q | 기대 |

|---|---|---|---|---|

| 1 | p == q → H(p) | [0.5, 0.5] | [0.5, 0.5] | 1 |

| 2 | 완벽 예측 one-hot | [1, 0] | [1, 0] | 0 |

| 3 | 완전 반대 | [1, 0] | [0, 1] | 매우 큰 (클리핑 후 유한) |

| 4 | 중간 | [1, 0] | [0.5, 0.5] | 1 |

| 5 | Gibbs 부등식 | 임의 p, q | H(p, q) >= H(p) |

Loading...

코드를 작성하고 Run 을 눌러보세요.