로지스틱 회귀 (경사하강법)

분류 · easy

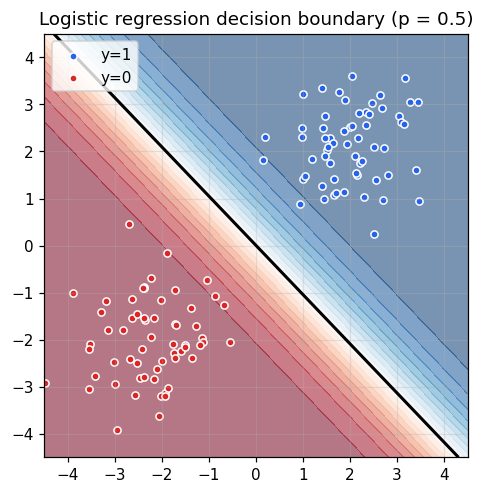

로지스틱 회귀 (Logistic Regression)

이진 분류의 가장 기본이 되는 선형 모델. 특성에 가중치 와 편향 를 곱해 점수를 내고, 시그모이드로 확률로 변환합니다:

BCE 손실의 경사는 놀랍도록 깔끔해요:

과제

함수 fit(X, y, lr, n_steps) -> (w, b) 를 완성하세요.

- 입력:

Xshape(N, D),yshape(N,)with{0, 1}. - 초기값:

w = 0 (D,),b = 0. n_steps회 경사하강.for루프 OK.- 반환:

(w, b)—w(D,) NumPy 배열,bfloat.

테스트 케이스

| # | 이름 | 검증 |

|---|---|---|

| 1 | 선형 분리 가능 데이터 | 학습 후 train 정확도 ≥ 0.95 |

| 2 | w shape | (D,) |

| 3 | 양성 방향 | 양성 중심에서 예측 확률 > 0.5 |

| 4 | 수렴성 | 100 steps 후 손실이 초기 대비 감소 |

Loading...

코드를 작성하고 Run 을 눌러보세요.